Гайди

Файл robots.txt: що це таке і навіщо потрібен

Файл robots.txt — це простий текстовий файл у корені сайту, який повідомляє пошуковим роботам (crawlers), які сторінки або розділи дозволено або заборонено сканувати. Він не є обов’язковим, але для будь-якого сайту з більш ніж десятком сторінок — це базовий інструмент управління краулінговим бюджетом і захисту від небажаної індексації.

Правильно налаштований robots.txt — це перша лінія захисту краулінгового бюджету. Він не замінює noindex, але разом вони дають повний контроль над тим, що потрапляє в пошук.

Що таке robots.txt

robots.txt — текстовий файл стандарту Robots Exclusion Protocol (REP), розробленого ще у 1994 році. Він розміщується виключно в корені домену: https://site.com/robots.txt. Пошуковий бот перевіряє цей файл перед початком сканування сайту.

Файл містить набір правил для різних ботів: Googlebot, Bingbot, AhrefsBot тощо. Можна задати окремі правила для кожного або одне загальне для всіх через User-agent: *.

Приклад мінімального robots.txt

User-agent: *

Disallow: /wp-admin/

Allow: /wp-admin/admin-ajax.php

Sitemap: https://site.com/sitemap_index.xmlНавіщо потрібен robots.txt

Основних причин кілька:

- Захист службових сторінок від індексації. Адмін-панель, сторінки авторизації, кошик, особистий кабінет — вони не повинні потрапляти в пошук

- Економія краулінгового бюджету. Google виділяє кожному сайту обмежений час на сканування. Якщо бот витрачає його на сторінки фільтрів або дублі — пріоритетні сторінки сканують рідше

- Запобігання дублювання контенту. Параметричні URL (наприклад,

?sort=price&order=asc) можуть створювати сотні дублів. Закриття через robots.txt або canonical вирішує проблему - Вказівка на Sitemap. Директива Sitemap прискорює знаходження нових сторінок

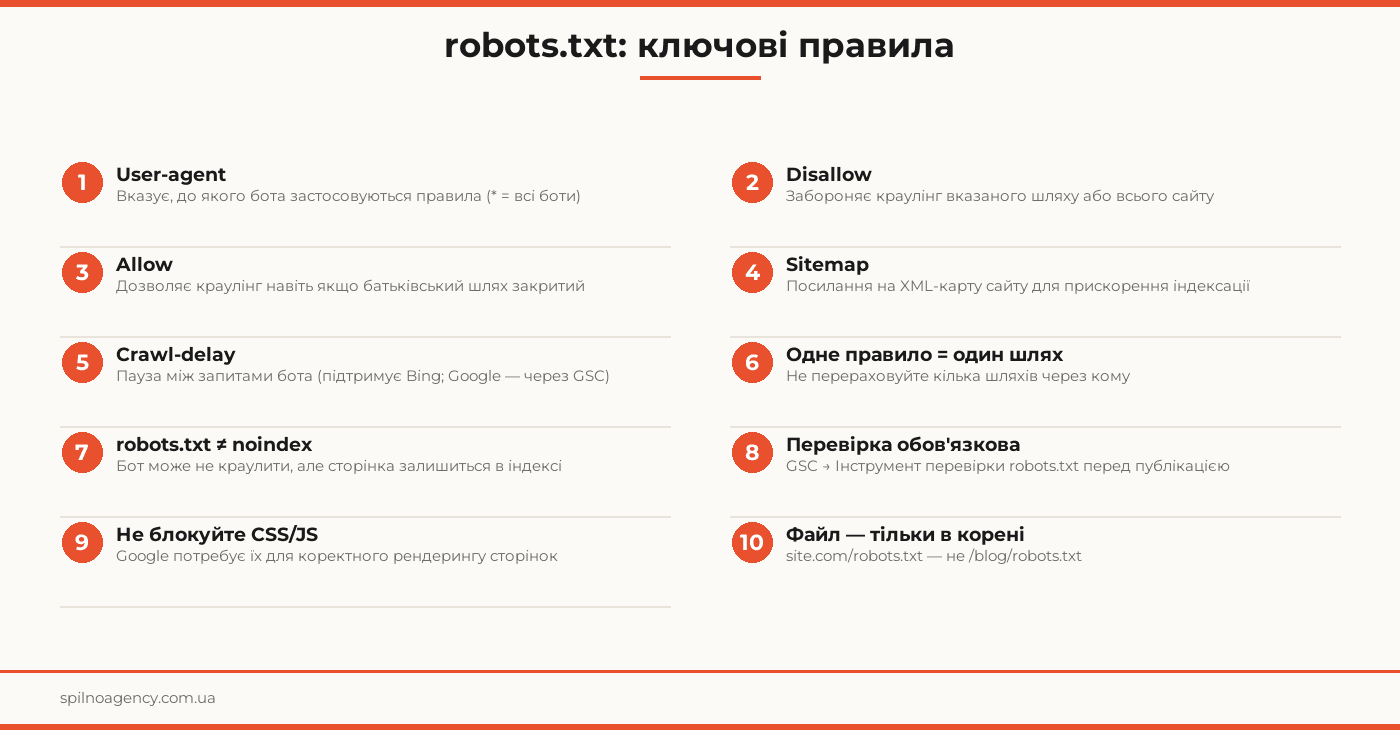

Синтаксис та директиви robots.txt

robots.txt має простий синтаксис: кожен рядок — одна директива. Порожні рядки розділяють блоки правил для різних ботів.

User-agent

Вказує, до якого бота застосовуються правила нижче. * означає всіх ботів.

User-agent: Googlebot

User-agent: *Disallow

Забороняє боту сканувати вказаний шлях. Порожнє значення (Disallow:) означає дозвіл на всі шляхи.

Disallow: /wp-admin/

Disallow: /checkout/

Disallow: /private/Allow

Явно дозволяє конкретний шлях навіть якщо батьківська директорія закрита через Disallow.

Disallow: /wp-admin/

Allow: /wp-admin/admin-ajax.phpSitemap

Вказує URL XML-карти сайту. Можна вказати кілька рядків Sitemap.

Sitemap: https://site.com/sitemap_index.xmlCrawl-delay

Затримка між запитами бота в секундах. Підтримується Bing, але не Googlebot (для Google налаштовуйте через GSC).

User-agent: Bingbot

Crawl-delay: 2Приклади robots.txt

WordPress-сайт

User-agent: *

Disallow: /wp-admin/

Disallow: /wp-login.php

Disallow: /xmlrpc.php

Disallow: /?s=

Disallow: /feed/

Allow: /wp-admin/admin-ajax.php

Sitemap: https://site.com/sitemap_index.xmlІнтернет-магазин

User-agent: *

Disallow: /cart/

Disallow: /checkout/

Disallow: /my-account/

Disallow: /wp-admin/

Disallow: /?orderby=

Disallow: /?filter_

Allow: /wp-admin/admin-ajax.php

Sitemap: https://shop.com/sitemap_index.xmlКорпоративний сайт (повністю відкритий)

User-agent: *

Disallow:

Sitemap: https://company.com/sitemap.xmlЯк перевірити robots.txt

Перевірка robots.txt — обов’язковий крок перед та після будь-яких змін.

- Google Search Console. Розділ «Інструменти та налаштування» → «Robots.txt Tester». Введіть URL сторінки — GSC покаже, чи дозволено краулінг і яке правило спрацьовує

- Пряме відкриття. Введіть

https://yoursite.com/robots.txtу браузер — переконайтеся, що файл відкривається і містить очікувані правила - curl у терміналі.

curl -s https://yoursite.com/robots.txt— швидка перевірка вмісту - Google Rich Results Test або Screaming Frog. Для перевірки доступності ресурсів (CSS, JS, зображень)

robots.txt vs noindex: в чому різниця

Це часто плутають, але це різні механізми з різними наслідками.

- robots.txt Disallow — забороняє боту відвідувати URL. Але якщо сторінка вже є в індексі або на неї ведуть зовнішні посилання — URL може залишатися в результатах пошуку навіть без вмісту

- noindex (мета-тег або X-Robots-Tag) — дозволяє боту відвідати сторінку, але наказує не включати її в індекс. Це надійніший спосіб прибрати сторінку з видачі

- Важливо: якщо сторінка закрита через Disallow і одночасно має noindex — бот не може прочитати noindex, і директива не спрацює. Відкрийте сторінку для краулінгу, щоб noindex подіяв

Типові помилки в robots.txt

- Закрити весь сайт випадково.

Disallow: /для всіх ботів — найпоширеніша катастрофічна помилка. Сайт зникає з пошуку - Блокувати CSS та JavaScript. Google потребує доступу до стилів та скриптів для рендерингу. Заблокований CSS = Google бачить сайт «поламаним», що шкодить ранжуванню

- Конфлікт robots.txt і noindex. Закрита сторінка не може передати noindex-сигнал боту — він її просто не читає

- Кілька шляхів в одному рядку.

Disallow: /admin/ /checkout/— невірний синтаксис. Кожен шлях — окремий рядок - Некоректний регістр. Директиви (

User-agent,Disallow) чутливі до регістру першої літери - robots.txt не в корені. Файл

/blog/robots.txtне буде прочитаний Googlebot

Чек-ліст robots.txt

- Файл robots.txt розміщений в корені домену (site.com/robots.txt)

- Кожен блок User-agent задає правила для конкретного бота або *

- Службові розділи закриті: /wp-admin/, /checkout/, /my-account/

- CSS та JavaScript НЕ заблоковані

- Директива Sitemap вказує на актуальну XML-карту сайту

- robots.txt не містить

Disallow: /для Googlebot або * - Файл перевірений через Google Search Console

- Сторінки, що потребують noindex — відкриті для краулінгу

- Crawl-delay налаштований для Bing якщо потрібно

- Зміни задокументовані та протестовані в dev-середовищі

Поширені питання

Чи обов’язковий файл robots.txt?

Ні, robots.txt не є обов’язковим. Якщо файл відсутній, пошукові роботи сканують весь сайт. Але для сайтів із закритими розділами (адмін-панель, кошик, особистий кабінет) robots.txt необхідний для захисту від індексації службових сторінок.

Чи блокує robots.txt індексацію сторінок?

Ні. Директива Disallow забороняє лише краулінг (сканування). Якщо на закриту сторінку є зовнішні посилання, Google може проіндексувати її URL без відвідування вмісту. Для повного виключення з індексу використовуйте мета-тег noindex або X-Robots-Tag.

Як перевірити, що robots.txt налаштований правильно?

Використайте Google Search Console → Інструменти → Перевірка robots.txt. Введіть URL сторінки й побачите, чи дозволений краулінг. Також можна перевірити через curl: curl -s https://site.com/robots.txt

Чи потрібен robots.txt для WordPress?

WordPress автоматично генерує базовий robots.txt через API. Але для гнучкого налаштування (закрити wp-admin, відкрити певні плагіни, додати Sitemap) рекомендується замінити його власним файлом або використати плагін Yoast SEO / Rank Math.

Яка різниця між robots.txt і noindex?

robots.txt керує краулінгом — забороняє або дозволяє боту відвідувати URL. noindex керує індексацією — дає боту дозвіл відвідати сторінку, але наказує не додавати її до індексу. Заборона краулінгу через robots.txt не гарантує видалення з індексу, якщо URL вже там.

Спробуйте безкоштовний аудит

Потрібен аудит robots.txt або технічне SEO вашого сайту? Spilno Agency проведе перевірку, виправить помилки та налаштує файл для максимальної ефективності краулінгу.