Инструкции

Файл robots.txt: что это такое и зачем нужен

robots.txt — это простой текстовый файл в корне сайта, который сообщает поисковым роботам (crawlers), какие страницы или разделы разрешено или запрещено сканировать. Файл не является обязательным, но для любого сайта с более чем десятком страниц — это базовый инструмент управления краулинговым бюджетом и защиты от нежелательной индексации.

Правильно настроенный robots.txt — это первая линия защиты краулингового бюджета. Он не заменяет noindex, но вместе они дают полный контроль над тем, что попадает в поиск.

Что такое robots.txt

robots.txt — текстовый файл стандарта Robots Exclusion Protocol (REP), разработанного ещё в 1994 году. Он размещается исключительно в корне домена: https://site.com/robots.txt. Поисковый бот проверяет этот файл перед началом сканирования сайта.

Файл содержит наборы правил для разных ботов: Googlebot, Bingbot, AhrefsBot и других. Можно задать отдельные правила для каждого или одно общее для всех через User-agent: *.

Пример минимального robots.txt

User-agent: *

Disallow: /wp-admin/

Allow: /wp-admin/admin-ajax.php

Sitemap: https://site.com/sitemap_index.xmlЗачем нужен robots.txt

Основных причин несколько:

- Защита служебных страниц от индексации. Панель администратора, страницы авторизации, корзина, личный кабинет — они не должны попадать в поиск

- Экономия краулингового бюджета. Google выделяет каждому сайту ограниченное время на сканирование. Если бот тратит его на страницы фильтров или дубли — приоритетные страницы сканируются реже

- Предотвращение дублирования контента. Параметрические URL (например,

?sort=price&order=asc) могут создавать сотни дублей. Закрытие через robots.txt или canonical решает проблему - Указание на Sitemap. Директива Sitemap ускоряет обнаружение новых страниц

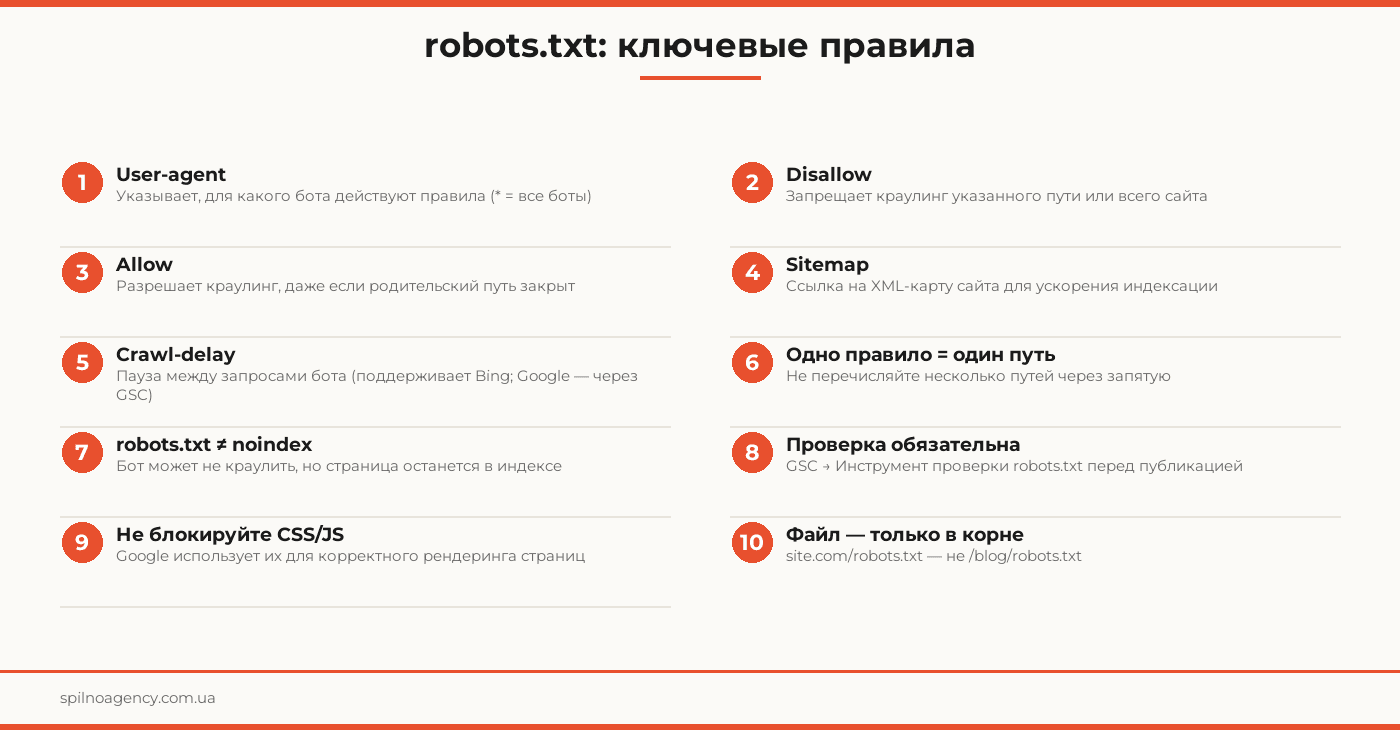

Синтаксис и директивы robots.txt

robots.txt имеет простой синтаксис: каждая строка — одна директива. Пустые строки разделяют блоки правил для разных ботов.

User-agent

Указывает, для какого бота действуют правила ниже. * означает всех ботов.

User-agent: Googlebot

User-agent: *Disallow

Запрещает боту сканировать указанный путь. Пустое значение (Disallow:) означает разрешение на все пути.

Disallow: /wp-admin/

Disallow: /checkout/

Disallow: /private/Allow

Явно разрешает конкретный путь, даже если родительская директория закрыта через Disallow.

Disallow: /wp-admin/

Allow: /wp-admin/admin-ajax.phpSitemap

Указывает URL XML-карты сайта. Можно указать несколько строк Sitemap.

Sitemap: https://site.com/sitemap_index.xmlCrawl-delay

Задержка между запросами бота в секундах. Поддерживается Bing, но не Googlebot (для Google используйте GSC).

User-agent: Bingbot

Crawl-delay: 2Примеры robots.txt

WordPress-сайт

User-agent: *

Disallow: /wp-admin/

Disallow: /wp-login.php

Disallow: /xmlrpc.php

Disallow: /?s=

Disallow: /feed/

Allow: /wp-admin/admin-ajax.php

Sitemap: https://site.com/sitemap_index.xmlИнтернет-магазин

User-agent: *

Disallow: /cart/

Disallow: /checkout/

Disallow: /my-account/

Disallow: /wp-admin/

Disallow: /?orderby=

Disallow: /?filter_

Allow: /wp-admin/admin-ajax.php

Sitemap: https://shop.com/sitemap_index.xmlКорпоративный сайт (полностью открытый)

User-agent: *

Disallow:

Sitemap: https://company.com/sitemap.xmlКак проверить robots.txt

Проверка robots.txt — обязательный шаг до и после любых изменений.

- Google Search Console. Раздел «Инструменты и настройки» → «Инструмент проверки robots.txt». Введите URL страницы — GSC покажет, разрешён ли краулинг и какое правило срабатывает

- Прямое открытие. Введите

https://yoursite.com/robots.txtв браузер — убедитесь, что файл открывается и содержит ожидаемые правила - curl в терминале.

curl -s https://yoursite.com/robots.txt— быстрая проверка содержимого - Screaming Frog или Google Rich Results Test. Для проверки доступности CSS, JS и изображений

robots.txt vs noindex: в чём разница

Это часто путают, но это разные механизмы с разными последствиями.

- robots.txt Disallow — запрещает боту посещать URL. Но если страница уже есть в индексе или на неё ведут внешние ссылки — URL может оставаться в результатах поиска даже без посещения содержимого

- noindex (мета-тег или X-Robots-Tag) — разрешает боту посетить страницу, но приказывает не включать её в индекс. Это надёжный способ убрать страницу из выдачи

- Важно: если страница закрыта через Disallow и одновременно имеет noindex — бот не может прочитать noindex, и директива не сработает. Откройте страницу для краулинга, чтобы noindex подействовал

Типичные ошибки в robots.txt

- Случайно закрыть весь сайт.

Disallow: /для всех ботов — самая катастрофическая ошибка. Сайт исчезает из поиска - Блокировать CSS и JavaScript. Google использует стили и скрипты для рендеринга. Заблокированный CSS = Google видит сайт «сломанным», что вредит ранжированию

- Конфликт robots.txt и noindex. Закрытая страница не может передать noindex-сигнал боту — он её просто не читает

- Несколько путей в одной строке.

Disallow: /admin/ /checkout/— неверный синтаксис. Каждый путь — отдельная строка - Некорректный регистр. Директивы (

User-agent,Disallow) чувствительны к регистру первой буквы - robots.txt не в корне. Файл

/blog/robots.txtне будет прочитан Googlebot

Чек-лист robots.txt

- Файл robots.txt размещён в корне домена (site.com/robots.txt)

- Каждый блок User-agent задаёт правила для конкретного бота или *

- Служебные разделы закрыты: /wp-admin/, /checkout/, /my-account/

- CSS и JavaScript НЕ заблокированы

- Директива Sitemap указывает на актуальную XML-карту сайта

- robots.txt не содержит

Disallow: /для Googlebot или * - Файл проверен через Google Search Console

- Страницы, требующие noindex — открыты для краулинга

- Crawl-delay настроен для Bing при необходимости

- Изменения задокументированы и протестированы в dev-среде

Часто задаваемые вопросы

Обязателен ли файл robots.txt?

Нет, robots.txt не является обязательным. Если файл отсутствует, поисковые роботы сканируют весь сайт. Но для сайтов с закрытыми разделами (админ-панель, корзина, личный кабинет) robots.txt необходим для защиты служебных страниц от индексации.

Блокирует ли robots.txt страницы в индексе Google?

Нет. Директива Disallow запрещает только краулинг (сканирование). Если на закрытую страницу ведут внешние ссылки, Google может проиндексировать её URL без посещения содержимого. Для полного исключения из индекса используйте мета-тег noindex или заголовок X-Robots-Tag.

Как проверить, что robots.txt настроен правильно?

Используйте Google Search Console → Настройки → Инструмент проверки robots.txt. Введите URL страницы и посмотрите, разрешён ли краулинг. Также можно проверить через терминал: curl -s https://yoursite.com/robots.txt

Нужен ли robots.txt для WordPress?

WordPress автоматически генерирует базовый robots.txt через API. Для гибкой настройки (закрыть wp-admin, открыть определённые плагины, добавить Sitemap) рекомендуется заменить его собственным файлом или настроить через Yoast SEO / Rank Math.

В чём разница между robots.txt и noindex?

robots.txt управляет краулингом — запрещает или разрешает боту посещать URL. noindex управляет индексацией — позволяет боту посетить страницу, но запрещает добавлять её в индекс. Запрет краулинга через robots.txt не гарантирует удаление из индекса, если страница уже там.

Бесплатный аудит robots.txt

Нужен аудит robots.txt или техническое SEO вашего сайта? Spilno Agency проверит настройки краулинга, исправит ошибки и оптимизирует файл для максимальной эффективности.