Instrukcje

Plik robots.txt: co to jest i jak go skonfigurować

robots.txt to prosty plik tekstowy umieszczony w katalogu głównym witryny, który informuje roboty wyszukiwarek (crawlery), które strony lub sekcje mogą — lub nie powinny — być skanowane. Nie jest obowiązkowy, ale dla każdej witryny z więcej niż kilkoma podstronami stanowi podstawowe narzędzie zarządzania budżetem crawlowania i ochrony przed niechcianą indeksacją.

Poprawnie skonfigurowany robots.txt to pierwsza linia ochrony budżetu crawlowania. Nie zastępuje noindex, ale razem dają pełną kontrolę nad tym, co trafia do indeksu wyszukiwarki.

Czym jest plik robots.txt?

robots.txt to plik tekstowy implementujący protokół Robots Exclusion Protocol (REP), standard wprowadzony w 1994 roku. Musi być umieszczony w katalogu głównym domeny: https://site.com/robots.txt. Każdy crawler sprawdza ten plik przed rozpoczęciem skanowania witryny.

Plik zawiera zestawy reguł skierowane do konkretnych botów — Googlebot, Bingbot, AhrefsBot i innych. Możesz pisać osobne bloki reguł dla każdego bota lub jeden wspólny za pomocą User-agent: *.

Przykład minimalnego pliku robots.txt

User-agent: *

Disallow: /wp-admin/

Allow: /wp-admin/admin-ajax.php

Sitemap: https://site.com/sitemap_index.xmlPo co jest potrzebny plik robots.txt?

Istnieje kilka kluczowych powodów:

- Ochrona stron administracyjnych. Panele logowania, koszyk, konto użytkownika — nie powinny trafiać do wyników wyszukiwania

- Ochrona budżetu crawlowania. Google przydziela każdej witrynie ograniczony czas skanowania. Jeśli bot marnuje go na strony filtrów lub duplikaty — ważne strony są crawlowane rzadziej

- Zapobieganie duplikacji treści. Parametryczne URL (np.

?sort=price&order=asc) mogą generować setki prawie identycznych stron. Blokowanie przez robots.txt lub canonical rozwiązuje ten problem - Wskazanie crawlerom na sitemapę. Dyrektywa Sitemap przyspiesza odkrywanie nowych stron

Składnia i dyrektywy pliku robots.txt

robots.txt używa prostej składni wiersz po wierszu. Każdy wiersz to jedna dyrektywa. Puste wiersze rozdzielają bloki reguł dla różnych botów.

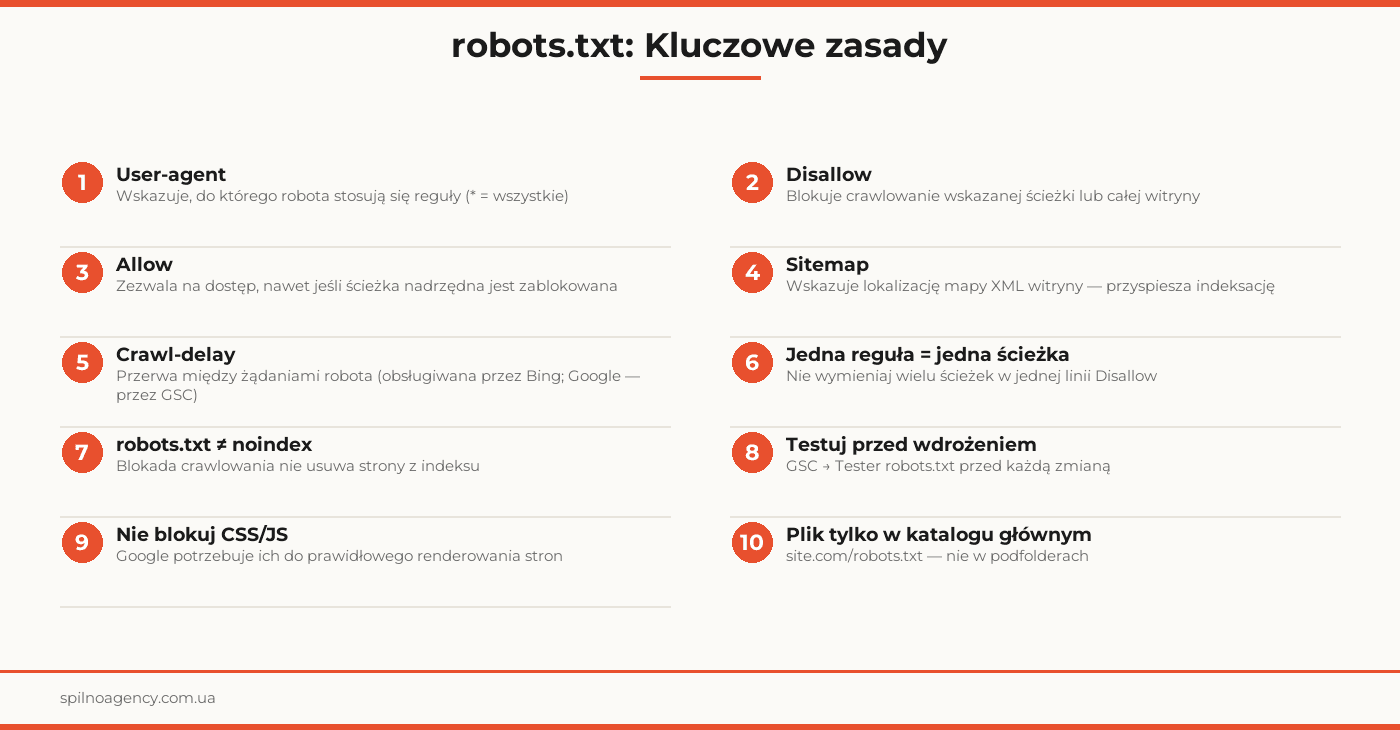

User-agent

Określa, do którego crawlera stosują się reguły poniżej. Użyj *, aby objąć wszystkie boty.

User-agent: Googlebot

User-agent: *Disallow

Mówi crawlerowi, że nie może odwiedzić wskazanej ścieżki. Pusta wartość (Disallow:) oznacza brak blokad.

Disallow: /wp-admin/

Disallow: /checkout/

Disallow: /private/Allow

Jawnie zezwala na konkretną ścieżkę, nawet gdy katalog nadrzędny jest zablokowany przez Disallow.

Disallow: /wp-admin/

Allow: /wp-admin/admin-ajax.phpSitemap

Podaje adres URL mapy XML witryny. Możesz dodać kilka wierszy Sitemap.

Sitemap: https://site.com/sitemap_index.xmlCrawl-delay

Ustawia pauzę (w sekundach) między żądaniami bota. Obsługiwana przez Bing — nie przez Googlebot (użyj ustawień częstotliwości crawlowania w GSC).

User-agent: Bingbot

Crawl-delay: 2Przykłady pliku robots.txt

Witryna WordPress

User-agent: *

Disallow: /wp-admin/

Disallow: /wp-login.php

Disallow: /xmlrpc.php

Disallow: /?s=

Disallow: /feed/

Allow: /wp-admin/admin-ajax.php

Sitemap: https://site.com/sitemap_index.xmlSklep internetowy

User-agent: *

Disallow: /cart/

Disallow: /checkout/

Disallow: /my-account/

Disallow: /wp-admin/

Disallow: /?orderby=

Disallow: /?filter_

Allow: /wp-admin/admin-ajax.php

Sitemap: https://shop.com/sitemap_index.xmlStrona firmowa (w pełni otwarta)

User-agent: *

Disallow:

Sitemap: https://company.com/sitemap.xmlJak przetestować plik robots.txt?

Testowanie jest obowiązkowe przed każdą zmianą w pliku robots.txt.

- Google Search Console. Ustawienia → Tester robots.txt. Wpisz adres URL — GSC pokaże, czy crawlowanie jest dozwolone i która reguła obowiązuje

- Bezpośrednie sprawdzenie. Otwórz

https://twojastrona.pl/robots.txtw przeglądarce — upewnij się, że plik jest dostępny i zawiera oczekiwane reguły - Sprawdzenie terminalem.

curl -s https://twojastrona.pl/robots.txt— szybka inspekcja zawartości - Screaming Frog lub Google Rich Results Test. Do sprawdzenia dostępności zasobów CSS, JS i obrazów dla crawlerów

robots.txt vs. noindex: jaka jest różnica?

To dwa odrębne mechanizmy o różnych konsekwencjach — mylenie ich to częsty błąd SEO.

- robots.txt Disallow — uniemożliwia crawlerowi odwiedzenie URL. Jeśli jednak strona jest już zaindeksowana lub wskazują na nią linki zewnętrzne, URL może pozostać w wynikach wyszukiwania

- noindex (meta tag lub nagłówek X-Robots-Tag) — pozwala botowi odwiedzić stronę, ale nakazuje mu jej nie indeksować. To niezawodny sposób na usunięcie strony z wyników wyszukiwania

- Ważne: jeśli strona jest zablokowana w robots.txt i ma też tag noindex — bot nie może odczytać noindex, bo nigdy nie odwiedza strony. Odblokuj crawlowanie, żeby sygnał noindex zadziałał

Typowe błędy w pliku robots.txt

- Przypadkowe zablokowanie całej witryny.

Disallow: /dla wszystkich botów to najpoważniejszy błąd — witryna znika z wyszukiwarki - Blokowanie CSS i JavaScript. Google potrzebuje dostępu do arkuszy stylów i skryptów, aby renderować strony. Zablokowany CSS = Google widzi witrynę jako uszkodzoną

- Konflikt robots.txt z noindex. Zablokowana strona nie może przekazać sygnału noindex — bot jej po prostu nie czyta

- Kilka ścieżek w jednym wierszu.

Disallow: /admin/ /checkout/to błędna składnia. Każda ścieżka wymaga osobnego wiersza Disallow - Problemy z wielkością liter. Nazwy dyrektyw (

User-agent,Disallow) są wrażliwe na wielkość pierwszej litery - Plik robots.txt poza katalogiem głównym. Plik w

/blog/robots.txtnie będzie odczytany przez Googlebot

Checklista robots.txt

- Plik robots.txt jest w katalogu głównym domeny (site.com/robots.txt)

- Każdy blok User-agent wskazuje konkretnego bota lub *

- Ścieżki administracyjne są zablokowane: /wp-admin/, /checkout/, /my-account/

- CSS i JavaScript NIE są zablokowane

- Dyrektywa Sitemap wskazuje aktualną mapę XML witryny

- Plik nie zawiera

Disallow: /dla Googlebot lub * - Plik przetestowany w Google Search Console

- Strony wymagające noindex są otwarte do crawlowania

- Crawl-delay ustawiony dla Bing jeśli potrzebny

- Wszystkie zmiany udokumentowane i przetestowane w środowisku deweloperskim

Najczęściej zadawane pytania

Czy plik robots.txt jest wymagany?

Nie, plik robots.txt nie jest obowiązkowy. Bez niego crawlery będą skanować całą witrynę. Jednak dla stron z panelami administracyjnymi, koszykami czy profilami użytkowników plik robots.txt jest niezbędny, aby zapobiec indeksacji stron technicznych.

Czy robots.txt blokuje strony w wynikach Google?

Nie. Dyrektywa Disallow blokuje wyłącznie crawlowanie — nie usuwa strony z indeksu. Jeśli zablokowany adres URL ma linki zewnętrzne, Google może go zaindeksować bez odwiedzania treści. Aby całkowicie wykluczyć stronę, użyj meta tagu noindex lub nagłówka X-Robots-Tag.

Jak sprawdzić poprawność pliku robots.txt?

Skorzystaj z Google Search Console → Ustawienia → Tester robots.txt. Wpisz adres URL, aby sprawdzić, czy crawlowanie jest dozwolone. Możesz też sprawdzić plik terminalem: curl -s https://twojastrona.pl/robots.txt

Czy WordPress potrzebuje własnego pliku robots.txt?

WordPress generuje domyślny plik robots.txt przez wirtualne API. Dla pełnej kontroli — blokady wp-admin, udostępnienia zasobów wtyczek, dodania adresu sitemapy — zastąp go fizycznym plikiem lub skonfiguruj przez Yoast SEO albo Rank Math.

Jaka jest różnica między robots.txt a noindex?

robots.txt kontroluje crawlowanie: mówi robotom, czy mogą odwiedzić URL. noindex kontroluje indeksację: pozwala robotowi odwiedzić stronę, ale nakazuje jej nie indeksować. Blokada crawlowania przez robots.txt nie gwarantuje usunięcia URL z indeksu, jeśli już tam jest.

Bezpłatny audyt pliku robots.txt

Potrzebujesz audytu pliku robots.txt lub pełnego przeglądu technicznego SEO? Spilno Agency przeanalizuje konfigurację crawlowania, naprawi błędy i zoptymalizuje plik pod maksymalną efektywność.